日ごとに身近な存在になりつつある、AI(人工知能)。戦争でも利用されているというニュースを耳にしますが、一体どのように使われているのでしょうか?

マモルの広報アドバイザー・志田音々さんが、元航空自衛官であり現在は研究所に所属する専門家・長島純さんに聞いてみました。

【志田音々さん】

1998年、埼玉県出身。2023年から防衛省広報アドバイザー(注1)を務める。25年11月上演予定の舞台『かげきしょうじょ‼ 第3章 The Final』にて主演を務める

【長島純さん】

1960年、東京都出身。元航空自衛官。防衛駐在官や幹部学校校長を歴任し、2019年退職。現在は、中曽根平和研究所に所属する傍ら、ブルキナファソ特命全権大使も務める

(注1)防衛省・自衛隊の各種広報活動に協力することを目的として2023年に設けられた制度のこと

軍事にAIはどう使われているの?

海上自衛隊の航空機に搭載するプログラムの開発や改善などを任務とする航空プログラム開発隊。AIの研究・開発なども行っている 写真/荒井健

志田音々(以下、「志田」):最近、さまざまなシーンでAIに触れる機会が増えてきました。

長島純(以下、「長島」):AIとはコンピュータに人間の知的行動を行わせる技術と言われていますが、世界共通の定義はありません。

その概念は1950年代から始まり、21世紀に入ってコンピュータの処理能力が向上し、データを分析・判断するディープ・ラーニング技術が導入されて性能が飛躍的に進歩しました。今では私たちの日常生活をサポートしていますね。

志田:SF映画『ターミネーター2』(1991年・アメリカ)では、自分で考えて行動する戦闘ロボットが、自分を犠牲にして人間を助けたシーンで感動しました。

長島:日本では『鉄腕アトム』や『ドラえもん』など、何十年も前から人間と共存するAI搭載ロボットが登場していますね。

志田:ニュースなどによると、戦争でも使われているとか?

長島:はい。ロシアによるウクライナ侵攻では、民間で開発したドローンに武器を搭載して攻撃型の無人機として使用していますが、目標の探知などにAIを使っています。

イスラエル軍もガザでの紛争で、攻撃目標の決定にAIの画像認識技術を使っています。将来的には、戦闘機がAIを搭載した複数の無人機を統制・指揮するようになる、とも言われています。

自衛隊でも、艦船の種類を判定する画像識別AIや、戦闘機の空中戦闘をサポートするAIなどの研究を行っています。

AIの強みと弱みって?

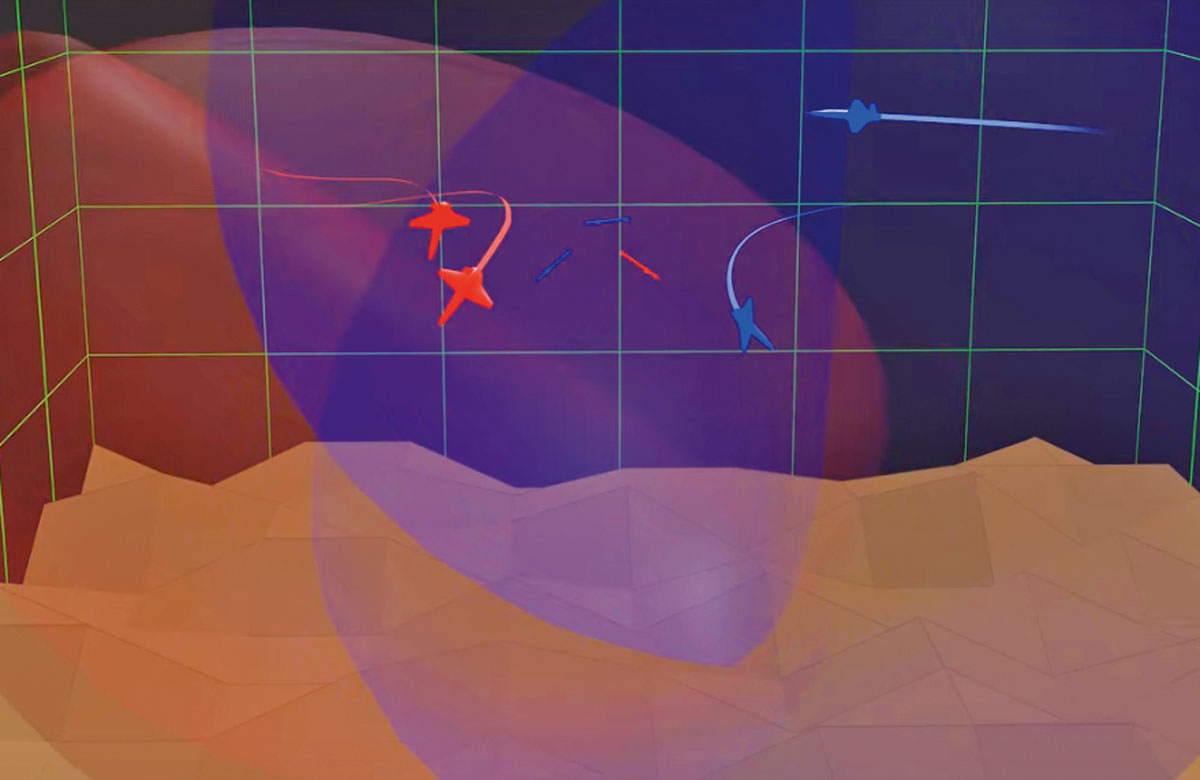

防衛装備庁では、AI技術について多様なアイデアを広く収集することを目的として、個人・法人が参加可能なAIの性能を競うコンテスト「空戦AIチャレンジ」を開催している。おのおのが開発したAIが複数の戦闘機を操作し、仮想空間上で戦わせて勝敗を競う(画像はイメージ)画像提供/防衛省

志田:そもそも、なぜ軍事にAIを導入するのでしょうか?

長島:戦場で扱うデータ量が膨大になり、人間では処理しきれなくなっているのが大きな理由です。

レーダーやソナーなどが探知したデータから敵の位置や規模などを割り出したり、敵が発射したミサイルや砲弾の軌道を解析したりするなど、現場では刻々と変わる状況から、常に短時間で最適解を出していかなければなりません。

そうした中で指揮官は、AIの力を借りながらさまざまな行動の選択肢を得られます。

志田:将棋や囲碁でも、一手指す(打つ)ごとにAIが勝率や最善手を示すみたいですね。

長島:もう1つの理由としては、人間は疲労すると判断力が鈍りますが、AIは疲れないことです。

志田:逆に、AIに弱点や苦手なことはあるのでしょうか?

長島:AIが苦手としているのは、空気を読んだり、想像することなどです。

AIは人間のように痛みや悲しみを感じないので、開発者が意図して学習させなければ、なんでもやってしまう無慈悲で残酷なものになります。さらに、たとえ過ちを犯しても謝罪することはありません。

また、AIは学習するデータや思考プログラムの違いによって、全く違う性格になるので、同じ命令をしても全く違う行動をとります。

志田:『ターミネーター』のように、AIが人に危害を加えた場合、それは誰の責任になるのですか?

長島:一応人間側の責任になるのではないかといわれていますが、AIに関する法的な整備や国際的なルール作りはまだ追い付いていません。

もはやAIは一国だけで抑制できない複雑で高度なものになっています。安全保障制度と同じように、AIも同じ価値観をもった国が協力して、開発や規制、ルール作りに取り組まなければなりません。

志田:アイザック・アシモフのSF作品に登場する、「ロボット憲章」(注2)のようなルールが早くできるといいですね。

(注2)「人間に危害を加えない」、「人間の命令に従う」、「自己を守る」という3つからなるロボットの行動規範

(MAMOR2025年10月号)

<文/古里学 写真/星亘(扶桑社)>

※記事内容は上記掲載号の発売時点のものです